@Photo: Rémi Hermoso

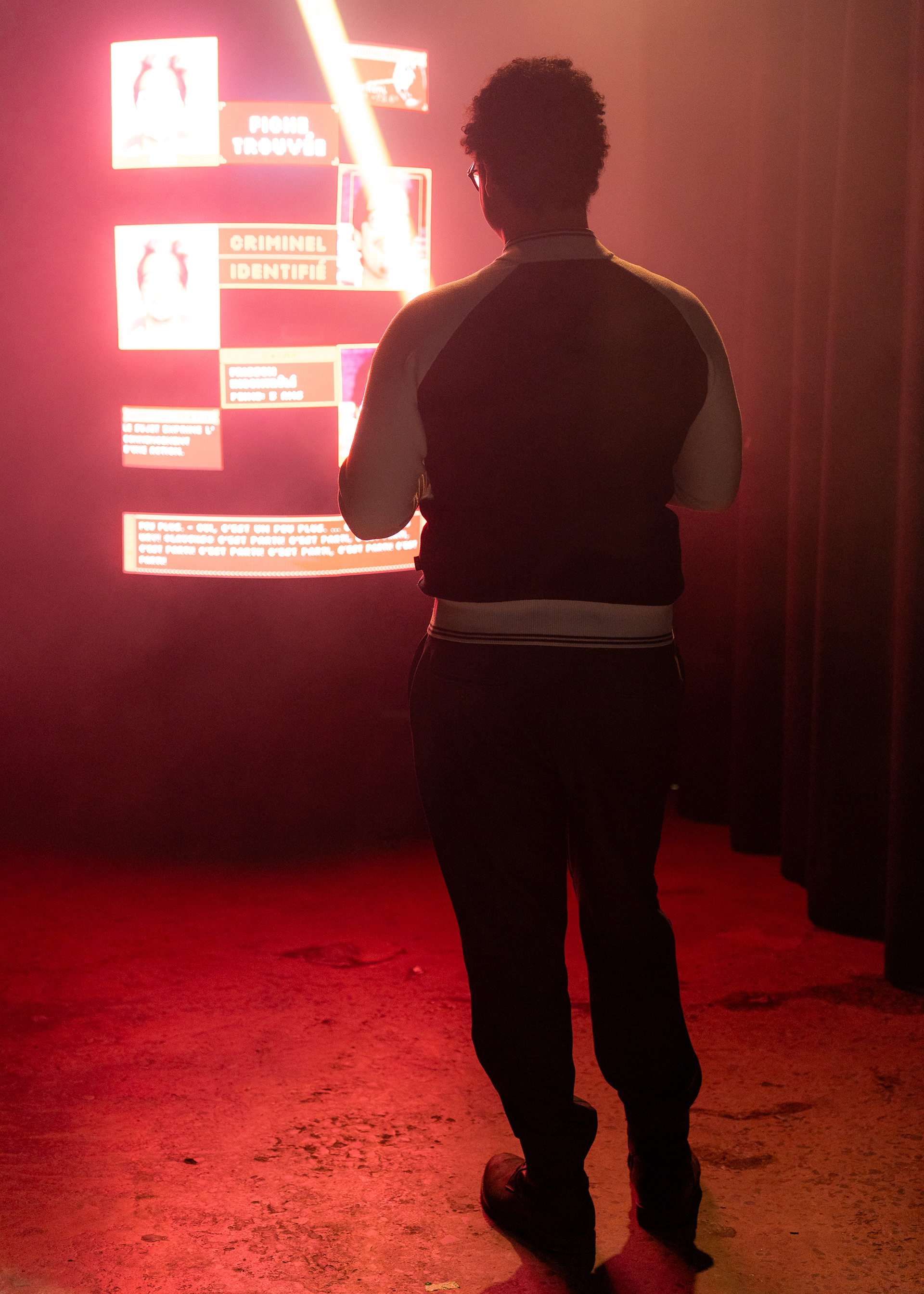

L’œuvre On/Record se présente d’abord comme un dispositif interactif et ludique, invitant le public à jouer avec son image, ses gestes et ses expressions. Cette entrée en matière volontairement accessible invite immédiatement à l’interaction. Face au dispositif, les participant.e.s sont amené.e.s à se déplacer, à tester différentes postures, à moduler leurs expressions faciales ou à émettre des sons, observant en retour les réactions du système. L’installation répond en temps réel à ces variations, générant des interprétations, qui encouragent l’exploration et le jeu.

Toutefois, cette dimension ludique opère un glissement progressif vers une prise de conscience : en interagissant avec le système, les participant.e.s réalisent qu’ils et elles sont simultanément observé.e.s, analysé.e.s et interprété.e.s. C’est à partir de cette expérience que l’œuvre développe une réflexion critique pour mettre en lumière certaines dérives potentielles liées au développement de systèmes de surveillance assistés par l’intelligence artificielle.

En effet, les modèles d’IA, de plus en plus sophistiqués, permettent aujourd’hui, à partir de simples caméras, non seulement de capter et d’enregistrer des images et du son, mais aussi de les analyser et de les interpréter automatiquement. Souvent justifiés au nom de la sécurité, ces dispositifs s’inscrivent dans des logiques de prévention et de contrôle qui peuvent sembler légitimes, mais qui comportent des risques importants de dérive. L’histoire nous a d’ailleurs montré que de tels outils peuvent être mobilisés dans des contextes autoritaires pour surveiller, catégoriser et contrôler les populations.

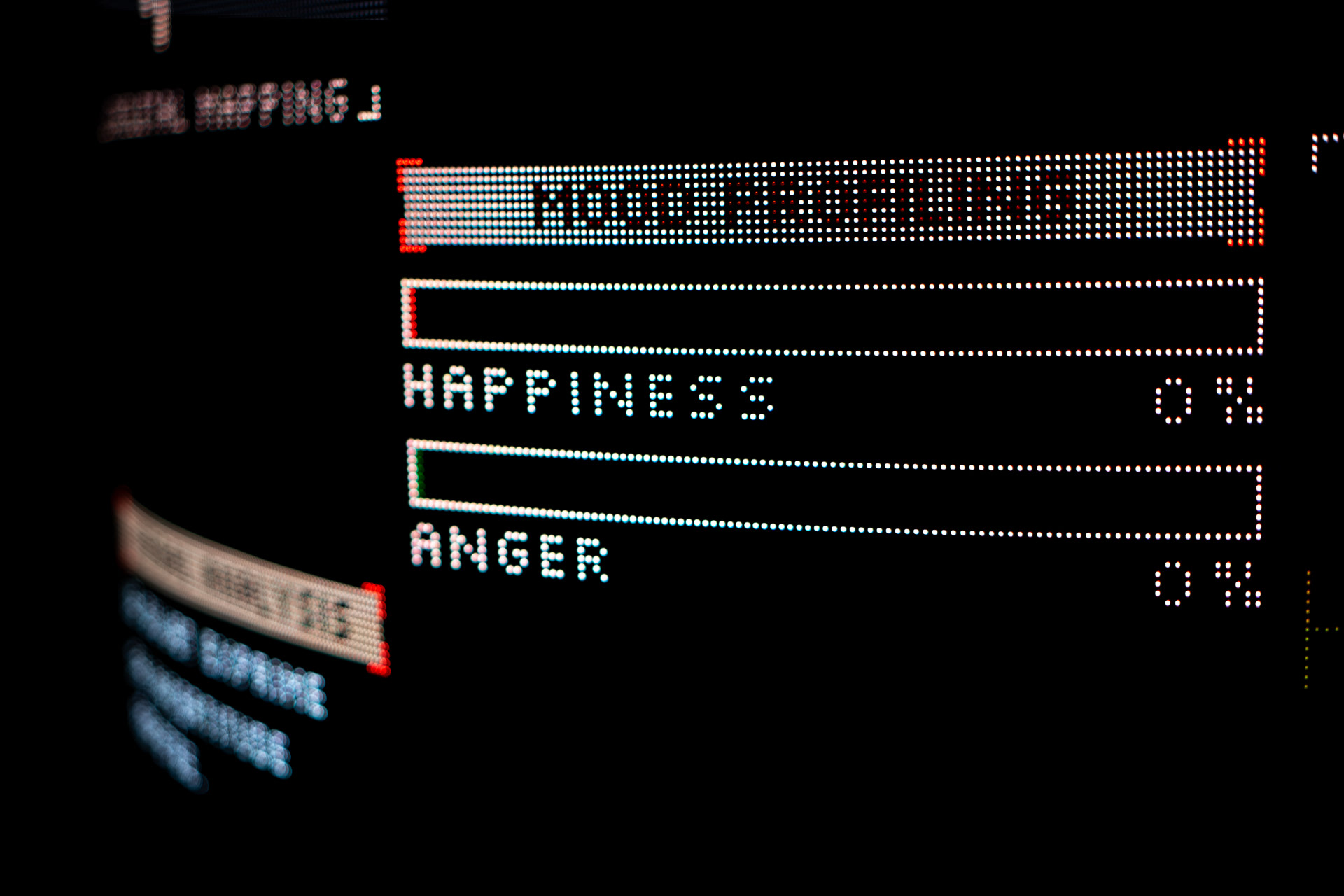

Ces systèmes peuvent comprendre le contenu des échanges, détecter certains propos, analyser les visages pour en déduire des émotions, ou encore identifier des individus à partir de bases de données. Les mouvements et les comportements eux-mêmes peuvent être suivis et interprétés. Ces technologies, déjà existantes et relativement accessibles, peuvent avoir des conséquences majeures, notamment en matière de contrôle social. Avec leur déploiement croissant, nos comportements peuvent être analysés en temps réel, et certaines personnes identifiées comme problématiques ou dangereuses. Le risque est alors de voir émerger un climat où l’on hésite à s’exprimer librement.

Dans On/Record, nous avons intégré plusieurs de ces modèles afin de rendre visibles, de manière explicite, ces mécanismes souvent invisibles, mais déjà à l’œuvre dans notre quotidien. Cette installation cherche ainsi à susciter une réflexion critique sur ces procédés, de plus en plus présents dans nos sociétés, et à interroger leur désirabilité : au nom de la sécurité, souhaitons-nous réellement évoluer dans des environnements où nos actions, nos paroles et même nos émotions sont analysées, interprétées et potentiellement jugées par des systèmes automatisés ?

The work On/Record initially presents itself as an interactive and playful setup, inviting the public to experiment with their image, gestures, and expressions. This deliberately accessible entry point immediately encourages interaction. Standing in front of the system, participants are prompted to move, try out different postures, modulate their facial expressions, or produce sounds, while observing how the system responds. The installation reacts in real time to these variations, generating interpretations that foster exploration and play.

However, this playful dimension gradually shifts toward a moment of awareness: as participants interact with the system, they come to realize that they are simultaneously being observed, analyzed, and interpreted. It is from this experience that the work develops a critical reflection, shedding light on certain potential risks associated with the development of AI-assisted surveillance systems.

Indeed, increasingly sophisticated AI models now make it possible, using simple cameras, not only to capture and record images and sound, but also to analyze and interpret them automatically. Often justified in the name of security, these systems operate within logics of prevention and control that may appear legitimate at first glance, yet carry significant risks of misuse. History has shown that such tools can be mobilized in authoritarian contexts to monitor, categorize, and control populations.

These systems can interpret the content of conversations, detect certain types of speech, analyze faces to infer emotions, and identify individuals through database matching. Movements and behaviors themselves can also be tracked and interpreted. These technologies, which already exist and are relatively accessible, can have major consequences, particularly in terms of social control. As their deployment expands, our behaviors can be analyzed in real time, and some individuals may be flagged as problematic or dangerous. The risk, then, is the emergence of a climate in which people hesitate to express themselves freely.

In On/Record, we have integrated several of these models in order to make these often invisible mechanisms explicit and perceptible, even though they are already active in our everyday lives. The installation thus seeks to provoke critical reflection on these processes, which are becoming increasingly present in our societies, and to question their desirability: in the name of security, do we truly want to live in environments where our actions, words, and even our emotions are analyzed, interpreted, and potentially judged by automated systems?